Любовь по алгоритму: Как ИИ помогает мошенникам разбивать сердца и кошельки

Криптовалютные романтические аферы с использованием ИИ

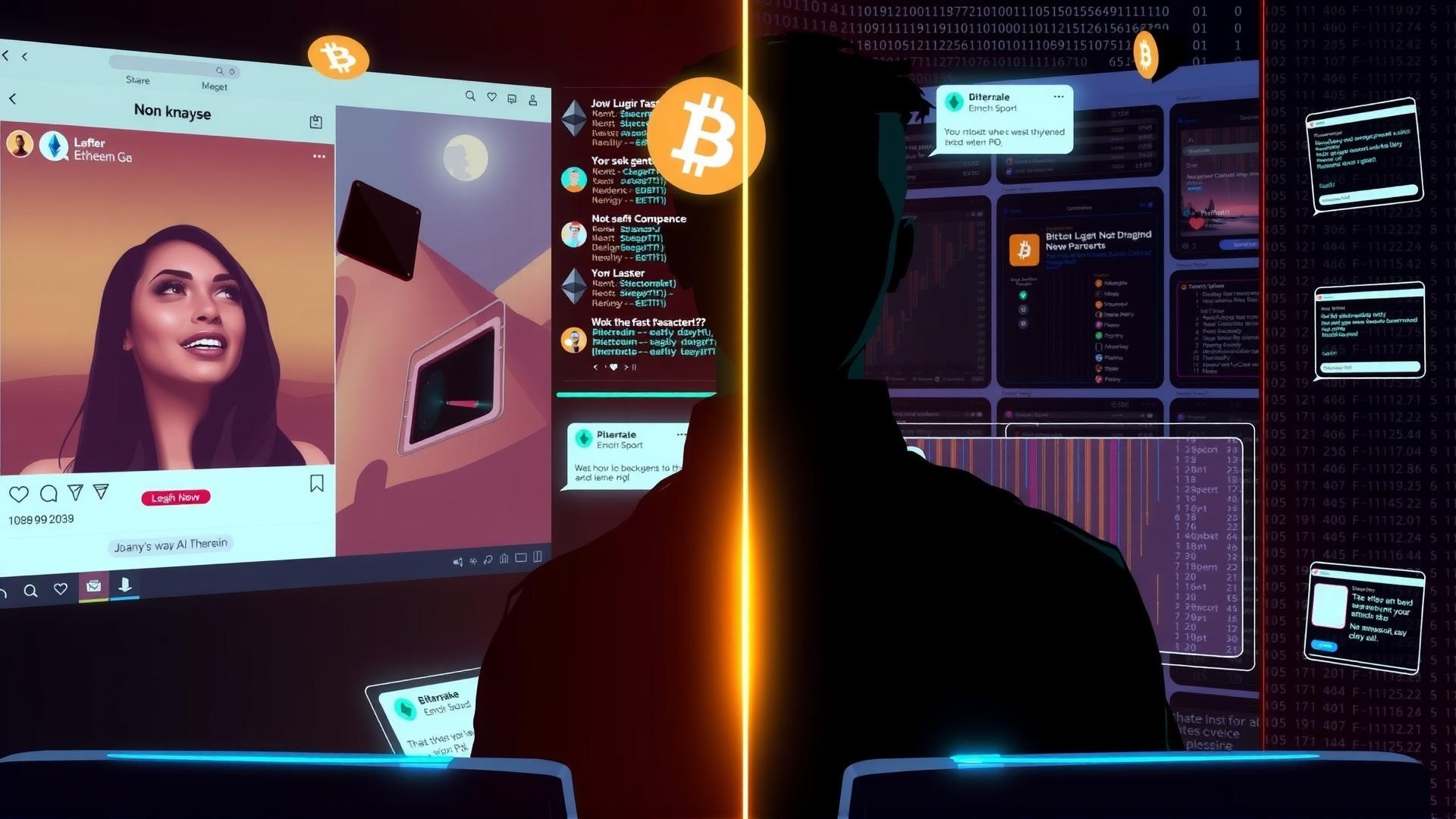

В современном мире мошенники часто используют искусственный интеллект для создания поддельных личностей, выдавая себя за доверенных общественных фигур. Показательный пример - арест около 800 человек в Нигерии за участие в криптовалютных романтических аферах, где преступники использовали ИИ-генерированный контент для обмана жертв на миллионы.

Технология клонирования голоса усиливает эффект глубоких подделок, добавляя человеческое измерение. ИИ способен точно воспроизводить речевые паттерны и тональность, позволяя мошенникам оставлять убедительные голосовые сообщения или совершать звонки в реальном времени. Такое персонализированное общение направлено на создание эмоциональной связи, критически важной для убеждения жертв перевести деньги.

Новые тенденции мошенничества 2025 года

В отличие от традиционных схем, требующих значительных человеческих ресурсов, современные мошенники могут одновременно атаковать сотни жертв. Чат-боты выполняют основную коммуникационную работу, поддерживая последовательное и правдоподобное взаимодействие на разных платформах. Такая масштабируемость позволяет получать максимальную прибыль при минимальных усилиях.

Выявление и защита

Распознавание криптовалютных романтических афер включает анализ таких признаков как отшлифованные профили, шаблонные разговоры и подозрительные финансовые запросы. Хотя обнаружение не всегда простое из-за сложности схем, знание характерных признаков может помочь избежать обмана.

Важную роль играют кампании по информированию общественности, обучающие пользователей распознаванию мошенничества с ИИ. Платформы вроде Reddit предоставляют актуальную информацию о новых тактиках мошенников, помогая людям оставаться бдительными.

Заключение

Эффективная защита от криптовалютных романтических афер требует комплексного подхода, сочетающего технологические инновации, регуляторный надзор и просвещение населения. Применение продуманных стратегий защиты помогает пользователям криптовалют противостоять растущей угрозе ИИ-мошенничества и способствует созданию более безопасной цифровой среды.